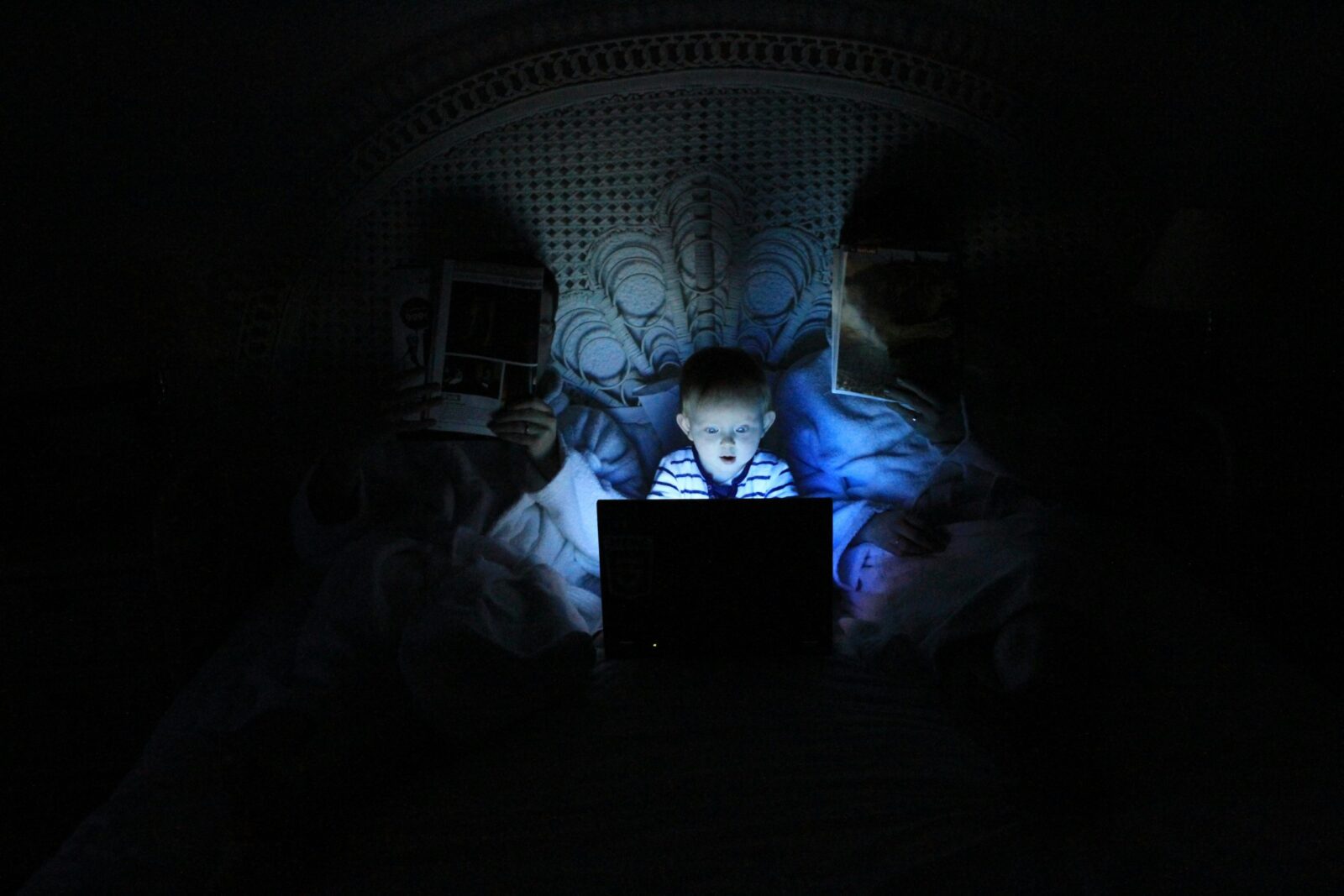

Os governos de toda a Europa debatem-se com uma questão que já não é abstrata ou teórica: os espaços digitais nos quais as crianças passam horas todos os dias estão a expô-las a níveis de risco sem precedentes. O debate já não é sobre se os menores são prejudicados online, mas sobre até onde os Estados, a União Europeia e as plataformas tecnológicas devem ir para lidar com esses danos, que vão desde o design viciante destas plataformas e os abusos gerados pela IA até ao cyberbullying, o acesso à pornografia e a influência extremista.

No entanto, a resposta da Europa assemelha-se a uma manta de retalhos de experimentações implementadas como respostas urgentes, reflexos políticos e profundas divergências filosóficas sobre direitos, vigilância e a própria infância. Como proteger os menores online está rapidamente a tornar-se uma das batalhas regulatórias mais sensíveis e determinantes da Europa.

Diferentes gatilhos para uma crise comum

O debate eclodiu em vários países. Em junho de 2025, a Áustria foi abalada quando um ex-aluno de 21 anos matou dez pessoas numa escola secundária em Graz antes de tirar a sua própria vida. Os investigadores descobriram que ele tinha até 30 perfis nas redes sociais e que estava a tornar-se cada vez mais retraído do mundo real e imerso no mundo virtual. O ataque provocou uma onda de choque política: o vice-chanceler Andreas Babler pediu a proibição das redes sociais para menores de 15 anos, argumentando que os algoritmos das plataformas globais se tornaram perigosos demais para serem usados sem controlo.

A Grécia foi confrontada com dois casos arrepiantes em setembro de 2025: um jovem de 13 anos que utilizou ferramentas de IA para criar e partilhar pornografia infantil, e um jovem de 25 anos que extorquiu imagens explícitas de menores de idade através das redes sociais. Em França, uma combinação do aumento do “vício em ecrãs”, o escândalo das “recompensas” do TikTok Lite e as crescentes preocupações com a exposição das crianças a violência e a conteúdos sexualizados levaram a questão para primeiro plano na agenda política.

Na Bulgária, o aumento do bullying, o uso omnipresente de smartphones nas escolas e um pico nos casos de exploração fizeram aumentar os apelos para que se tomassem medidas.

A situação em toda a Europa é surpreendentemente semelhante: as crianças passam mais tempo online em idades mais jovens e com menos proteção do que nunca, enquanto os danos que enfrentam estão a aumentar.

A tentação da proibição

Em resposta a tudo isto, um número crescente de governos europeus considerou ou adotou a ideia de proibir o acesso às redes sociais por menores. Além do chanceler da Áustria, o primeiro-ministro da Grécia e o ministro da Educação da Bulgária discutiram publicamente a possibilidade de restringir o acesso a menores de 15 anos, enquanto uma comissão do Parlamento Europeu chegou a sugerir a implementação da “idade adulta digital” aos 16 anos em todo o continente.

No entanto, o instinto de proibir é imediatamente recebido com uma resistência igualmente forte em toda a Europa, por parte de especialistas em direitos digitais, ONG de segurança infantil, reguladores e psicólogos. Na Áustria, especialistas como Moussa Al-Hassan Diaw, da associação de prevenção do extremismo Derad, e Verena Fabris (Centro de Aconselhamento sobre Extremismo)afirmaram que, embora uma proibição possa ter uma leitura política, também pode tornar as plataformas ainda mais atraentes para os adolescentes. Os defensores dos direitos digitais, como Thomas Lohninger, da ONG de participação social Epicenter Works, insistiram que os menores têm o direito de participar no mundo digital. “A Internet não é apenas o TikTok e o Instagram”,disse ao Der Standard. Na sua opinião, a restrição causaria “danos colaterais inaceitáveis.”

Na Bulgária, a especialista em segurança infantil Antoaneta Vasileva descreveu estas proibições absolutas como “um ato simbólico” que cria uma falsa sensação de segurança, já que as crianças podem contorná-las usando perfis falsos ou os dispositivos dos pais. E enfatizou que o principal risco não é simplesmente o acesso à Internet, mas a falta de educação, maturidade emocional e relações de apoio que ensinariam as crianças a navegar com segurança nos espaços online.

A mesma preocupação é sentida em França, onde crianças de apenas quatro anos estão a ser atraídas para o scroll infinito — muitas vezes guiadas por pais persuadidos pelo marketing de influencers. Os educadores relatam que muitos jovens utilizadores simulam atos vistos em conteúdos para adultos sem perceber as suas implicações. As linhas de apoio nacionais, como a e-Enfance / 3018, lidam com milhares de casos de assédio, extorsão sexual e conteúdo manipulador.

Na opinião de especialistas, reguladores e educadores, proibir o acesso parece impraticável e insuficiente — não resolve nada, a menos que as crianças sejam ensinadas a navegar o mundo online, reconhecer os seus riscos e confiar em adultos responsáveis.

O aumento da verificação de idade: uma promessa e um perigo

A Europa está a convergir não no sentido de proibir, mas antes de verificar a idade. A questão é como verificar a idade sem criar sistemas de vigilância maciça.

Espanha tentou a medida mais ousada em 2024: o governo propôs exigir que todos os utilizadores que acedessem a pornografia online verificassem a sua idade usando um sistema de identificação eletrónico nacional através da aplicação Cartera Digital. O objetivo era impedir que menores de 18 anos acedessem a conteúdo para adultos. No entanto, especialistas em criptografia, especialistas em privacidade e defensores das liberdades civis alertaram imediatamente que o sistema era tecnicamente imperfeito, apresentava riscos do ponto de vista jurídico e era perigoso para a privacidade pessoal. O plano fracassou devido a pressão pública e objeções técnicas,relatou o El Confidencial.

Outros países, como a Grécia, estão agora a testar ferramentas mais sofisticadas. Como parte de um programa piloto da UE, este país planeia incorporar a verificação da idade, o controlo parental e filtros de conteúdo numa aplicação nacional chamada Kids Wallet, que deverá ser lançada até ao final de 2025.

França também está a experimentar programas piloto de verificação de idade, em conformidade com a Lei dos Serviços Digitais (LSD). Os reguladores destacam que qualquer sistema deve encontrar o equilíbrio entre a eficácia e a proteção de dados, e evitar a criação de uma identificação digital universal. No entanto, os defensores dos direitos digitais alertam que um sistema de verificação poderoso o suficiente para bloquear menores provavelmente também identificará e rastreará adultos. A questão, portanto, não é apenas como bloquear crianças, mas também se a verificação de idade deve ser permitida numa democracia digital livre.

O papel das plataformas: do design viciante às falhas de responsabilização

Em toda a Europa, surge um segundo fio condutor comum: o design das próprias plataformas de redes sociais. Para muitos especialistas, o perigo não é apenas o que as crianças veem, mas como são levadas a ver.

Em 2024, o TikTok Lite lançou um sistema de “recompensas” em França e Espanha que dava pontos e incentivos aos utilizadores por assistirem a mais vídeos e iniciarem sessão diariamente. A medida gerou indignação, especialmente entre os defensores da segurança infantil. Sob pressão, a Comissão Europeia abriu uma investigação formal ao abrigo da DSA sobre “design viciante” – e o TikTok suspendeu a funcionalidade. O caso ilustrou pela primeira vez que a DSA poderia forçar plataformas com presença em todo o mundo a reverter escolhas de design.

Na França, uma investigação parlamentar analisou os riscos que os algoritmos de recomendação, a viralidade impulsionada pela IA e as pressões estruturais exercidas pelas plataformas representam para a saúde mental dos menores. Os reguladores estão cada vez mais a tratar essas questões como falhas de design, em vez de mera má conduta do utilizador, exigindo que as plataformas repensem os seus serviços tendo em conta o bem-estar das crianças.

Escolas, pais e a linha ténue entre a vida online e offline

As escolas em toda a Europa estão a transformar-se em campos de batalha para as normas digitais. Na Bulgária, por exemplo, o Ministério da Educação estendeu a proibição de smartphones a todos os “dispositivos com ecrã” durante o horário escolar, a partir de novembro de 2025. Enquanto isso, em França, as autoridades estão a debater restrições ao uso de ecrãs na educação infantil, recomendando uma supervisão mais rigorosa das atividades online dos adolescentes e um “recolher obrigatório digital” das 22h às 8h.

No entanto, os especialistas insistem que as escolas não podem arcar sozinhas com essa responsabilidade. Desde muito jovens, as crianças estão imersas num mundo digital que muitas vezes é moldado pelos adultos ao seu redor. Em muitos lares, os pais criam perfis nas redes sociais para crianças pequenas ou as incentivam-nas a publicar como influencers — às vezes sem compreender totalmente os riscos associados.

Órgãos reguladores, como a autoridade de proteção de dados da França, a CNIL, já emitem diretrizes sobre o sharenting, pedindo aos pais para pensar duas vezes antes de publicar fotografias ou vídeos dos seus filhos online. Vários países europeus adotaram legislação semelhante à lei francesa de 2020 sobre os direitos de imagem das crianças, que concede aos menores o controlo sobre as fotos e vídeos deles publicados pelos pais para uso comercial. Uma nova lei em 2024 alargou a maioria das suas cláusulas à vida quotidiana das crianças, impondo aos pais o dever jurídico de proteger a imagem digital dos seus filhos e permitindo que os menores solicitem a remoção de conteúdos.

No entanto, em todas as capitais — de Viena a Atenas e Paris — os especialistas repetem a mesma mensagem: a linha de defesa mais eficaz continua a ser a relação entre crianças e adultos. Não são as firewalls. Não são as proibições. Não são as aplicações.

Como afirma Antoaneta Vasileva, especialista em segurança infantil na Bulgária, “a proteção mais segura é um diálogo aberto e as crianças saberem que não estão sozinhas, mesmo quando se encontram numa situação difícil online.”

As crianças precisam de saber que podem procurar ajuda, denunciar assédio e reconhecer manipulação. Os adultos — pais, professores, cuidadores — precisam de desenvolver laços de confiança, fomentar a literacia digital e orientar as crianças a navegar pelo mundo online de forma segura e responsável.

O papel da UE: mais ambicioso do que os seus Estados-Membros

A nível europeu, a proteção das crianças tornou-se uma das frentes mais contestadas da regulamentação digital. A Lei dos Serviços Digitais e a futura Lei da Inteligência Artificial (IA) impõem obrigações sem precedentes às plataformas para avaliar os riscos para os menores, desenvolver serviços mais seguros e remover conteúdos nocivos.

Mas a proposta mais controversa da UE continua a ser o Regulamento para Prevenir e Combater o Abuso Sexual Infantil (RPCASI) — apelidado de “Chat Control” pelos críticos. O seu objetivo é exigir que as plataformas detetem, removam e denunciem material de abuso sexual infantil (MASI), mesmo em espaços encriptados e mensagens privadas.

Os defensores da medida argumentam que esta é a única forma realista de detetar formas modernas de aliciamento, extorsão e exploração baseada em imagens, que atualmente passam despercebidas. Vasileva e outros especialistas em proteção infantil acreditam que o “Chat Control” poderia oferecer um nível de proteção muito mais elevado do que as proibições que têm por base a idade.

No entanto, Vasileva, juntamente com defensores da privacidade e organizações de direitos digitais, alertam que a digitalização em massa de mensagens privadas normalizaria a vigilância para todos. Além disso, afirmam que esta medida prejudicaria a criptografia e transformaria as comunicações privadas em fluxos regulamentados e monitorizados, uma mudança significativa com sérias consequências para a liberdade pessoal em toda a Europa.

E em 26 de novembro, o Parlamento Europeu aprovou por ampla maioria uma resolução pedindo uma proteção mais forte contra estratégias manipuladoras que podem levar ao vício e prejudicar a capacidade das crianças de se concentrar e interagir com conteúdos online de maneira saudável. Os eurodeputados também propuseram uma idade mínima digital padronizada na UE de 16 anos para aceder às redes sociais, plataformas de partilha de vídeos e assistentes de IA. Também foi determinado que jovens de 13 a 16 anos acedessem a estes com o consentimento dos pais e deram o seu apoio ao trabalho da Comissão para desenvolver uma aplicação de verificação de idade da UE, assim como a carteira de identidade digital europeia (eID), tendo sempre presente a garantia da privacidade dos menores.

No mesmo dia, os Estados-Membros da UE chegaram a acordo sobre uma posição comum relativa a um regulamento para prevenir e combater o abuso sexual de crianças, incluindo no mundo online. Uma vez adotada, a nova lei obrigará as empresas digitais a impedir a divulgação de material relacionado com o abuso sexual de crianças e o aliciamento de crianças. Os governos nacionais poderão exigir às empresas que removam conteúdos e bloqueiem o acesso aos mesmos ou, no caso dos motores de pesquisa, que os removam dos resultados de pesquisa. O regulamento proposto também estabelece uma nova agência da UE, o Centro Europeu de Proteção da Criança, que prestará apoio aos Estados-Membros e fornecedores online na implementação da lei.

O equilíbrio entre a proteção das crianças online e a salvaguarda da privacidade de milhões de pessoas está no centro da política europeia. A questão que se coloca é se é possível alcançar ambos os objetivos ou se eles são incompatíveis.

Em vez de um modelo europeu unificado, o que está a emergir é um entendimento comum em todo o continente europeu: a infância é agora inseparável do mundo digital, e deixar esse mundo sem regulamentação já não é uma opção. Tal obriga a Europa a enfrentar uma escolha difícil: se deve confiar em proibições restritivas, investir em estratégias orientadas para a educação, redesenhar plataformas para a segurança, expandir ferramentas de vigilância ou, de forma mais realista, tentar um equilíbrio frágil entre todas estas abordagens. No entanto, mesmo neste panorama fragmentado, um princípio destaca-se: o preço a pagar pela proteção não ser a capacidade das crianças de navegar no seu próprio ambiente digital. Como Antoaneta Vasileva nos lembra, “precisamos de desenvolver as competências das crianças para reconhecerem os riscos e lidarem com os desafios online de forma madura e ponderada, competências que as ajudarão a tornarem-se resilientes, pensadoras críticas e participantes responsáveis no mundo digital.”

Este artigo foi publicado como parte do projeto europeu PULSE, e teve os contributos de György Folk (EUrologus/HVG), Manuel Ángel Méndez e M. Mcloughlin (El Confidencial), Giota Tessi (Efsyn) e Desislava Koleva (Mediapool).